Mit Matching lokalisieren

Mit diesem Tool können Sie Objekte anhand eines Matching-Vorgangs lokalisieren.

Übersicht

Dieses Tool wird mit einem Trainingsmodus verwendet. Dabei wird zunächst ein Training der zu lokalisierenden Objekte mit festgelegten Trainingsparametern durchgeführt. Das Training beginnt automatisch, wenn Trainingsparameter festgelegt oder geändert werden.

Das Trainingsmodell kann dann im gleichen Tool mit weiteren Bildern getestet werden.

Wenn Objekte mit Matching lokalisiert werden, wird zunächst das trainierte Modell der Objekte in den Bildern gesucht. Wird eine Instanz des Modells gefunden, zählt diese als Objekt.

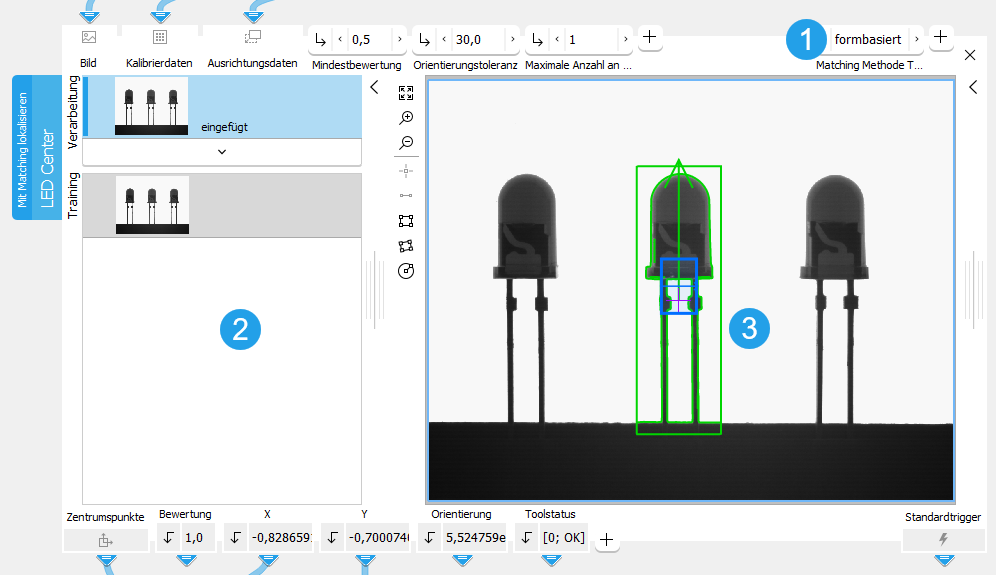

Das Tool verfügt über einen Trainingsbereich auf der linken Seite des Toolboards. Es bietet die Möglichkeit, durch Klicken auf das jeweilige Bild zwischen dem Verarbeitungsmodus für die Suche und dem Trainingsmodus zum Trainieren des Matching-Modells zu wechseln. Im Grafikfenster wird das Bild des derzeit aktiven Modus angezeigt, der im Trainingsbereich blau hervorgehoben wird. Zusätzlich zu den Suchparametern oben links stellt das Tool oben rechts im Tool weitere Parameter für das Training bereit.

Weitere Informationen zur Verwendung von Tools, für die ein Training erforderlich ist, finden Sie unter Im Trainingsmodus arbeiten.

Das Toolboard ist in den Trainingsbereich auf der linken Seite der und das Grafikfenster auf der rechten Seite unterteilt.

![]() Trainingsparameter

Trainingsparameter

![]() Trainingsbereich

Trainingsbereich

![]() Grafikfenster

Grafikfenster

Trainingseinstellungen definieren

Trainingsbild auswählen

Das erste Bild auf der linken Seite des Toolboards zeigt das momentan geladene Bild, das zweite das Trainingsbild.

Für dieses Tool kann nur ein Bild als Trainingsbild verwendet werden. Wenn das Tool eingefügt wird, wird das aktuelle Verarbeitungsbild automatisch als Trainingsbild verwendet. Sie können auch die folgenden Schritte ausführen, um das Trainingsbild zu ändern:

- Führen Sie die Anwendung in Einzelschritten aus, bis das gewünschte Bild im Grafikfenster und somit im „Verarbeitungsbereich“ angezeigt wird.

- Klicken Sie auf die Schaltfläche

im Trainingsbereich auf der linken Seite, um das aktuelle Trainingsbild durch das Bild im „Verarbeitungsbereich“ zu ersetzen. Der Trainingsmodus wird automatisch aktiviert und das neue Trainingsbild wird im Grafikfenster angezeigt.

Matching-Modell auswählen

Für dieses Tool sind easyTouch und easyTouch+ verfügbar. Das heißt, Sie können das Matching-Modell für die Ausrichtung wie folgt interaktiv auswählen:

- Klicken Sie auf das Trainingsbild im linken Bereich des Toolboards. Das Trainingsbild wird im Grafikfenster angezeigt und Sie können mit der Auswahl des Matching-Modells beginnen.

- Bewegen Sie die Maus über das Bild, um eine Vorschau der ROI für das Modell zu erhalten. Sie können mithilfe der Schaltflächen zur ROI-Auswahl auch eine Modell-ROI zeichnen. Wenn Sie easyTouch verwenden, um das Modell auszuwählen, zeigt die Farbe der in der Vorschau angezeigten Modell-ROI an, inwieweit die ROI, d. h. das Objekt im Rechteck, für das Training geeignet ist. Genauigkeit, Maßstab und Drehungsinvarianz hängen von Kontrast, Größe und Form des zugrunde liegenden Objekts ab. Die verschiedenen Farben haben folgende Bedeutung:

- Eine wahrscheinlich gute Modell-ROI wird in der definierten Farbe für „akzeptiert“ hervorgehoben (standardmäßig grün).

- Wird die Modell-ROI in der definierten Farbe für „Warnung“ hervorgehoben (standardmäßig gelb), eignet sie sich nicht sehr gut für das Training, möglicherweise aufgrund fehlender Modellkanten oder einer zu geringen Anzahl von Modellkanten.

- Eine schlechte Modell-ROI wird in der definierten Farbe für „zurückgewiesen“ hervorgehoben (standardmäßig rot). Wenn das Rechteck sehr nah am Bildrand liegt, erfolgt die Darstellung in Rot, da das Objekt in den verarbeiteten Bildern u. U. nur teilweise sichtbar ist.

- Klicken Sie auf die ROI, wenn Sie die hervorgehobene ROI für die Ausrichtung verwenden möchten, um die Auswahl zu bestätigen. Die entsprechenden Trainingsparameter werden automatisch bestimmt.

Sucheinstellungen definieren

Suchparameter anpassen

Im Gegensatz zu den Trainingsparametern werden die Suchparameter auf der linken Seite nicht automatisch angepasst. Sie hängen von den Bildern Ihrer Anwendung ab und müssen entsprechend angepasst werden.

Sie können überprüfen, ob die aktuellen Einstellungen der Trainings- und Suchparameter geeignet sind. Wenn Sie die Anwendung mit mehreren Bildern ausführen, können Sie im Grafikfenster sofort feststellen, ob das Matching-Modell in allen Bildern ordnungsgemäß gefunden wurde. Bei Bedarf können Sie weitere Anpassungen an den Parametern vornehmen.

Bereichseinschränkungen

Die Objekte werden innerhalb eines Bereichs gesucht, der durch den „Verarbeitungsbereich“ und die „Such ROI“ bestimmt wird.

Ein Objekt wird ausgegeben, wenn sein Schwerpunkt innerhalb dieses Suchbereichs liegt. Falls der Schwerpunkt außerhalb der Objekte im Suchbereich liegt, ist der Suchbereich so anzupassen, dass der Schwerpunkt innerhalb des Suchbereichs liegt. Dadurch wird sichergestellt, dass das Objekt gefunden wird.

Objekte, die teilweise außerhalb des Bildes liegen, werden bei der Verarbeitung ignoriert.

Parameter

Abhängig von der ausgewählten Trainingsmethode am Parameter „Matching-Methode - Training“ sind einige Verbindungsstellen ausgegraut. Das bedeutet, dass sie für die aktuell ausgewählte Trainingsmethode nicht verfügbar sind und somit keine Auswirkung haben.

Standardparameter

Bild:

Dieser Parameter stellt das Bild dar, in dem die Objekte gefunden werden sollen. Es kann entweder als Trainingsbild für die Bestimmung des Matching-Modells oder als Verarbeitungsbild zum Testen des festgelegten Matching-Modells verwendet werden.

Bei der Verwendung eines Farbbilds als Eingabebild für dieses Tool wird nur der erste Kanal, d. h. der rote Kanal, für die Verarbeitung verwendet.

Mindestbewertung:

Dieser Parameter ist ein numerischer Wert, der die Genauigkeit der Positionsbestimmung angibt. Er bestimmt, wie viel des Trainingsmodells im Bild sichtbar sein muss. Die Standardeinstellung ist 0,5. Damit kann die Hälfte des Modells im Bild verdeckt sein. Sie können den Wert über die zugehörige Verbindungsstelle ändern. Der Wert kann eine Zahl zwischen „0,1“ und „1“ sein. Je höher die „Mindestbewertung“, desto schneller ist die Suche. Wenn davon auszugehen ist, dass das Modell in den Bildern niemals verdeckt wird, kann ein hoher Wert für die „Mindestbewertung“ eingegeben werden, d. h. 0,8 oder sogar 0,9.

Zur Beschleunigung der Suche wird eine sogenannte Pyramide von verkleinerten Bildern verwendet. Eine Übereinstimmung benötigt eine Bewertung, die auf jeder Ebene groß genug ist, um als solche erkannt zu werden. Dies kann dazu führen, dass Übereinstimmungen ausgeschlossen werden, obwohl deren Bewertung im Originalbild größer ist als die minimale Bewertung, weil sie auf einer höheren Verkleinerungsebene nicht ausreichend erkennbar sind. Diese ausgelassenen Übereinstimmungen können mit einer geringeren Mindestbewertung gefunden werden.

Sie können die aktuelle „Mindestbewertung“ überprüfen, indem Sie die Anwendung schrittweise ausführen und prüfen, ob das Vorhandensein der Objekte in allen Bildern ordnungsgemäß ermittelt wird.

Orientierungstoleranz:

Dieser Parameter definiert die Toleranz des Rotationswinkels, mit dem das Objekt im Bild erscheinen darf. Er wird in Grad angegeben und ist standardmäßig auf 180° festgelegt. Sie können über die zugehörige Verbindungsstelle die „Orientierungstoleranz“ ändern und einen Winkel zwischen 0° und 180° festlegen.

Maximale Anzahl an Objekten:

Dieser Parameter definiert die „Maximale Anzahl an Objekten“, die im Bild gezählt werden sollen. Der Parameter ist standardmäßig auf 1 festgelegt. Sie können den Wert über die zugehörige Verbindungsstelle ändern. Eine Erhöhung des Werts „Maximale Anzahl an Objekten“ kann zu einer längeren Suchdauer führen.

Zusätzliche Parameter

Such ROI:

Dieser Parameter definiert die ROI für die Verarbeitung. Bildteile außerhalb der Vereinigung von ROI und „Verarbeitungsbereich“ werden nicht verarbeitet.Wenn zudem einer der Bereiche leer ist, wird der Bildteil, der innerhalb des jeweils anderen liegt, verarbeitet. Sind beide leer, wird das gesamte Bild verarbeitet. Bei Verwendung von easyTouch zur Auswahl des Matching-Modells wird jedoch das ganze Bild bei der Verarbeitung verwendet.

Die ROI ist standardmäßig als leere ROI definiert. Wenn Sie eine nicht leere ROI für die Verarbeitung verwenden möchten, müssen Sie den Parameter mit einem geeigneten ROI-Ergebnis eines vorherigen Tools verbinden oder mit den verfügbaren ROI-Schaltflächen neue ROIs zeichnen.

Es kann ausreichend sein, wenn nur ein Teil des trainierten Modells, z. B. nur eine der beiden Modell-ROIs, im Suchbereich liegt, um eine Übereinstimmung zu finden. Wenn das trainierte Modell außerhalb dieses Bereichs liegt, wird es nicht gefunden.

Kalibrierdaten:

Dieser Parameter definiert die Kalibrierdaten, die für die Korrektur eventueller Linsenverzerrungen sowie der Position der Kamera in Bezug auf die Bildebene erforderlich sind. Standardmäßig sind keine Kalibrierdaten definiert. Wenn Sie Kalibrierdaten verwenden möchten, müssen Sie den Parameter mit einem geeigneten Ergebnis eines vorherigen Tools, z. B. Kamera kalibrieren, verbinden, damit die Kalibrierdaten an dieses Tool übertragen werden. Sie werden sofort auf das Bild angewendet.

Falls „Kalibrierdaten“ für dieses Tool verwendet werden, werden alle Ergebnisse, die Pixelwerte darstellen, automatisch in die entsprechenden Weltkoordinaten transformiert.

Ausrichtungsdaten:

Dieser Parameter stellt die Ausrichtungsdaten dar, die zum Ausrichten der ROI verwendet werden. Ausrichtungsdaten sind standardmäßig nicht verbunden, sodass keine Auswirkung sichtbar ist. Wenn Sie bestimmte Ausrichtungsdaten verwenden möchten, müssen Sie den Parameter mit einem geeigneten Ergebnis eines vorherigen Tools verbinden, z. B. Ausrichtungsdaten mit Matching bestimmen, Ausrichtungsdaten mittels geradem Rand bestimmen, Bild ausrichten oder Bild drehen.

Deformationstoleranz:

Dieser Parameter definiert die maximal zulässige Deformation des Objekts. Er wird in Pixeln angegeben und ist standardmäßig auf 1 px festgelegt. Dies bedeutet, dass auch Objekte gefunden werden, die hinsichtlich der Form des Trainingsmodells Deformationen von bis zu 1 Pixel aufweisen. Sie können den Wert über die zugehörige Verbindungsstelle ändern und einen ganzzahligen Wert zwischen 0 und 5 px sowie darüber festlegen, wenn Sie den Wert manuell eingeben. Wenn Sie den Wert auf 0 px festlegen, werden nur Objekte ohne Deformationen gefunden. Je höher die „Deformationstoleranz“, desto höher ist allerdings das Risiko, dass nicht die richtigen Objekte gefunden werden. Dies gilt vor allem für Objekte mit feinen Strukturen.

Die „Deformationstoleranz“ sollte daher so niedrig wie möglich, aber so hoch wie nötig sein. Wenn das Ausmaß der Deformation des Modells, die in den Bildern zu erwarten ist, bekannt ist, können Sie den Wert für die „Deformationstoleranz“ entsprechend anpassen. Die „Deformationstoleranz“ ist nur gültig, wenn „Matching-Methode - Training“ auf „formbasiert“ festgelegt ist.

Maximale Überlappung:

Dieser Parameter legt die maximal zulässige Überlappung der zu zählenden Objekte fest, d. h. er definiert eine Toleranz für diese Überlappung. Die Überlappung wird im Hinblick auf das kleinste umgebende Rechteck um das Objekt bestimmt und nicht im Hinblick auf die Fläche des Objekts selbst. Daher ist es möglich, dass zwei Objekte überlappen, obwohl ihre tatsächlichen Flächen sich nicht überschneiden. Die „Maximale Überlappung“ wird als Prozentwert dargestellt und ist standardmäßig auf 50 % festgelegt. Das bedeutet, dass bis zu 50 % des kleinsten umgebenden Rechtecks eines Objekts im Suchbild verdeckt sein kann und das Objekt trotzdem bei der Zählung berücksichtigt wird. Wenn mehr als 50 % des Objekts verdeckt ist, wird es nicht gezählt. Sie können den Wert für „Maximale Überlappung“ über die zugehörige Verbindungsstelle ändern und einen Wert zwischen 0 und 100 festlegen. Wenn Sie den Wert 0 festlegen, werden nur Objekte ohne Überlappung gefunden. Je höher allerdings die „Maximale Überlappung“, desto höher ist das Risiko, dass falsche Objekte gefunden werden.

Verarbeitungsbereich:

Dieser Parameter definiert die Region für die Verarbeitung. Bildteile außerhalb der Vereinigung von ROI und „Verarbeitungsbereich“ werden nicht verarbeitet. Wenn zudem einer der Bereiche leer ist, wird der Bildteil, der innerhalb des jeweils anderen liegt, verarbeitet. Sind beide leer, wird das gesamte Bild verarbeitet.

„Verarbeitungsbereich“ ist standardmäßig als leere Region definiert. Wenn Sie eine „Verarbeitungsbereich“ angeben möchten, müssen Sie den Parameter mit einem geeigneten Ergebnis eines vorherigen Tools verbinden, damit die Region an dieses Tool übertragen wird.

Bei Verwendung von easyTouch zur Auswahl des Matching-Modells wird das ganze Bild bei der Verarbeitung verwendet.

Trainingsparameter

Standard-Trainingsparameter

Matching-Methode - Training:

Dieser Trainingsparameter definiert das Matching-Modell, das zum Bestimmen des Trainingsmodells verwendet wird. Der Parameter ist standardmäßig auf „formbasiert“ festgelegt. Sie können den Parameter „Matching-Methode - Training“ über die zugehörige Verbindungsstelle ändern.

|

Wert |

Beschreibung |

|---|---|

|

formbasiert |

Dieser Matching-Ansatz beschreibt das Trainingsmodell anhand seiner Konturformen. Verwenden Sie diese Methode, wenn das Trainingsmodell anhand einer Matching-Methode bestimmt werden sollen, die die besten Übereinstimmungen eines formbasierten Modells in einem Bild findet. |

|

korrelationsbasiert |

Dieser Matching-Ansatz beschreibt das Trainingsmodell anhand der Grauwertrelationen der enthaltenen Pixel. Verwenden Sie diese Methode, wenn das Trainingsmodell anhand einer Matching-Methode bestimmt werden sollen, die für die Suche nach übereinstimmenden Objekten und Mustern eine normalisierte Kreuzkorrelation (NCC) verwendet. |

Zusätzliche Trainingsparameter

Die zusätzlichen Trainingsparameter werden der jeweiligen Matching-Methode entsprechend aufgelistet. Es ist möglich, Parameter anderer Methoden festzulegen. Diese haben aber keinen Einfluss auf das resultierende Trainingsmodell.

Dieser Trainingsparameter definiert den Kantenkontrast des verwendeten Modells. Er wird in Grauwerten angegeben und ist standardmäßig auf 10 festgelegt. Das heißt, dass Objekte mit einem Kontrast von mindestens 11 Grauwerten gefunden werden. Es gibt verschiedene Möglichkeiten, um den Kantenkontrast festzulegen:

- Automatisch mit easyTouch

Verwenden Sie easyTouch, um die Objekte im Trainingsbild auszuwählen. Der Parameterwert wird automatisch Ihrer easyTouch-Auswahl entsprechend angepasst.

- Automatisch mit ROIs

Legen Sie den Kantenkontrast an der Verbindungsstelle manuell auf 0 fest und zeichnen Sie eine Modell-ROI über die einzelnen Teile im Trainingsbild, in dem Referenzobjekte ermittelt werden sollen. Das Tool erkennt automatisch alle möglichen Objekte mit einem Kontrast. Wenn Sie weitere Objekte als Referenz für das Training hinzufügen möchten, müssen Sie die Modell-ROI manuell in das Bild zeichnen. Der Parameterwert an der Verbindungsstelle bleibt 0, bis Sie den Wert manuell ändern oder easyTouch verwenden.

- Manuell

Legen Sie den gewünschten Kantenkontrast an der Verbindungsstelle manuell fest und zeichnen Sie eine Modell-ROI über die einzelnen Teile im Trainingsbild, in dem Sie Referenzobjekte ermitteln möchten. Sie können den Wert mit dem Schieberegler festlegen oder einen Wert zwischen 1 und 1.000.000.000 in das Textfeld eingeben. Es werden alle möglichen Objekte gefunden, die zum definierten Kantenkontrast passen. Wenn Sie weitere Objekte als Referenz für das Training hinzufügen möchten, müssen Sie die Modell-ROI manuell in das Bild zeichnen. Wenn Sie easyTouch zum Auswählen der Objekte verwenden, wird der Parameterwert automatisch angepasst, sodass die vorher definierte Einstellung verloren geht.

Dieser Trainingsparameter definiert den Kantenkontrast, der bei der Suche der Objekte in den Trainingsbildern verwendet wird. Er wird in Grauwerten angegeben und ist standardmäßig auf 5 festgelegt. Das heißt, dass Objekte mit einem Kontrast von mindestens 6 Grauwerten gefunden werden. Es gibt verschiedene Möglichkeiten, um den Kantenkontrast festzulegen:

- Automatisch miteasyTouch

Verwenden Sie easyTouch, um die Objekte im Trainingsbild auszuwählen. Der Parameterwert wird automatisch Ihrer easyTouch-Auswahl entsprechend angepasst.

- Automatisch mit ROIs

Legen Sie den Kantenkontrast an der Verbindungsstelle manuell auf 0 fest und zeichnen Sie eine Modell-ROI über die einzelnen Teile im Trainingsbild, für die der Kantenkontrast bestimmt und für die Suche verwendet werden soll. Das Tool erkennt automatisch alle möglichen Objekte mit einem Kontrast. Wenn Sie weitere Objekte als Referenz für den Kantenkontrast hinzufügen möchten, müssen Sie die Modell-ROI manuell in das Bild zeichnen. Der Parameterwert an der Verbindungsstelle bleibt 0, bis Sie den Wert manuell ändern oder easyTouch verwenden.

- Manuell

Legen Sie den gewünschten Kantenkontrast an der Verbindungsstelle manuell fest und zeichnen Sie eine Modell-ROI über die einzelnen Teile im Trainingsbild, für die Sie die Kanten mit dem definierten Kantenkontrast ermitteln möchten. Sie können den Wert mit dem Schieberegler festlegen oder einen Wert zwischen 1 und 1.000.000.000 in das Textfeld eingeben. Es werden alle möglichen Objekte gefunden, die zum definierten Kantenkontrast passen. Wenn Sie weitere Objekte als Referenz für das Training hinzufügen möchten, müssen Sie die Modell-ROI manuell in das Bild zeichnen. Wenn Sie easyTouch zum Auswählen der Objekte verwenden, wird der Parameterwert automatisch angepasst, sodass die vorher definierte Einstellung verloren geht.

Dieser Parameter definiert die Anzahl der Pyramidenstufen, die bei der Suche verwendet werden. Der Parameter ist standardmäßig auf „auto“ festgelegt. Die „Höchste Pyramidenstufe“ wird automatisch durch easyTouch bestimmt, wenn eine Modell-ROI im Trainingsbild ausgewählt wurde. Sie können den Wert auch manuell über die zugehörige Verbindungsstelle ändern und eine Stufe zwischen 2 und 8 festlegen. Der Wert sollte so groß wie möglich gewählt werden, um die Zeit für das Finden des Objekts möglichst kurz zu halten. Wird er jedoch zu groß gewählt, wird das Modell möglicherweise nicht mehr erkannt. Daher muss er klein genug gewählt werden, damit das Modell noch erkannt wird.

Die Auswahl der geeigneten Pyramidenstufe, d. h. die höchste Pyramidenstufe, auf der mindestens eine Instanz des Formmodells gefunden werden kann, hängt von dem Modell und dem Eingabebild ab. Die geeignete „Höchste Pyramidenstufe“ kann von Bild zu Bild variieren. Bei Eingabebildern schlechter Qualität, d. h. bei defokussierten, deformierten oder verrauschten Bildern, wird unter Umständen mit den Standardeinstellungen keine Instanz des Modells gefunden, da möglicherweise Kanten fehlen oder deformiert sind. Legen Sie in diesem Fall einen niedrigeren Wert für „Höchste Pyramidenstufe“ fest.

Wird der Parameter „Höchste Pyramidenstufe“ zu klein festgelegt, dauert es länger, bis das Modell gefunden wird, und MERLIC wird verlangsamt. Dies tritt vor allem dann auf, wenn sehr große Bilder verwendet werden. In diesem Fall empfehlen wir, den Wert für „Höchste Pyramidenstufe“ zu erhöhen.

Dieser Trainingsparameter definiert die Mindestlänge der verwendeten Modellkanten. Er wird in Pixeln angegeben und ist standardmäßig auf 5 px festgelegt. Es gibt verschiedene Möglichkeiten, um die Länge der Kanten zu bestimmen:

- Automatisch mit easyTouch

Verwenden Sie easyTouch, um die Objekte im Trainingsbild auszuwählen. Der Parameterwert wird automatisch Ihrer easyTouch-Auswahl entsprechend angepasst.

- Automatisch mit ROIs

Legen Sie den Kantenkontrast an der Verbindungsstelle manuell auf 0 fest und zeichnen Sie eine Modell-ROI über die einzelnen Teile im Trainingsbild, in denen die minimale Kantenlänge für das Training bestimmt werden soll. Das Tool erkennt automatisch die minimale Länge aller möglichen Kanten. Wenn Sie weitere Objekte für das Training hinzufügen möchten, müssen Sie die Modell-ROI manuell in das Bild zeichnen. Der Parameterwert an der Verbindungsstelle bleibt 0, bis Sie den Wert manuell ändern oder easyTouch verwenden.

- Manuell

Legen Sie die gewünschte Kantenlänge an der Verbindungsstelle manuell fest und zeichnen Sie eine Modell-ROI über die einzelnen Teile im Trainingsbild, in denen Sie die Kanten mit der definierten Länge ermitteln möchten. Dadurch haben Sie die Möglichkeit festzulegen, dass nur Modellkanten mit der angegebenen Mindestlänge beim Training berücksichtigt werden. Sie können den Wert mit dem Schieberegler festlegen oder einen Wert zwischen 1 und 1.000.000.000 px in das Textfeld eingeben. Wenn Sie weitere Objekte für das Training hinzufügen möchten, müssen Sie die Modell-ROI manuell in das Bild zeichnen. Wenn Sie easyTouch zum Auswählen der Objekte verwenden, wird der Parameterwert automatisch angepasst, sodass die vorher definierte Einstellung verloren geht.

Der Parameter bestimmt die Bedingungen, unter denen das Modell im Bild erkannt wird. Die Standardeinstellung ist „Polarität verwenden“.

|

Wert |

Beschreibung |

|---|---|

|

Polarität verwenden |

Wenn diese Polaritätsmetrik verwendet wird, müssen das Objekt im Trainingsbild und das Verarbeitungsbild den gleichen Kontrast aufweisen. Wenn das Modell beispielsweise ein helles Objekt auf einem dunklen Hintergrund ist, wird das Objekt nur gefunden, wenn es ebenfalls heller als der Hintergrund ist. Diese Metrik kann nur auf einkanalige Bilder angewendet werden. Wird ein mehrkanaliges Bild als Trainingsbild oder Verarbeitungsbild verwendet, wird nur der erste Kanal verwendet. |

|

Farbpolarität ignorieren |

Bei Verwendung dieser Polaritätsmetrik wird das Modell auch dann gefunden, wenn sich der Farbkontrast lokal ändert, z. B. bei einer Änderung der Objektfarbe von grün in rot. Dieser Modus ist nützlich, wenn Sie vorab nicht wissen, in welchen Kanälen das Objekt sichtbar ist. Die Laufzeit im Verarbeitungsmodus kann bei dieser Polaritätsmetrik jedoch erheblich größer werden. Diese Metrik kann für Bilder mit einer beliebigen Anzahl von Kanälen verwendet werden. Bei Verwendung für einkanalige Bilder ist die Auswirkung wie bei „lokale Polarität ignorieren“. Die Anzahl der Kanäle bei der Erstellung des Trainingsmodells und der Suche muss nicht übereinstimmen. Dies bietet die Möglichkeit, ein Modell aus einem synthetisch generierten, einkanaligen Bild zu erstellen. Darüber hinaus müssen die Kanäle keine spektrale Unterteilung des Lichts wie in einem RGB-Bild enthalten. Die Kanäle können auch Bilder des gleichen Objekts enthalten, die bei Beleuchtung des Objekts aus unterschiedlichen Richtungen entstanden sind. |

|

globale Polarität ignorieren |

Bei Verwendung dieser Polaritätsmetrik wird das Modell auch dann im Bild gefunden, wenn der Kontrast global umgekehrt wird. Ist das Objekt beispielsweise ein helles Objekt auf einem dunklen Hintergrund, wird das Objekt nicht nur dann gefunden, wenn es heller als der Hintergrund ist (wie bei "Polarität verwenden"), sondern auch, wenn es dunkler als der Hintergrund ist. In diesem Fall wird die Laufzeit im Verarbeitungsmodus geringfügig größer. Diese Metrik kann nur auf einkanalige Bilder angewendet werden. Wird ein mehrkanaliges Bild als Trainingsbild oder Verarbeitungsbild verwendet, wird nur der erste Kanal verwendet. |

|

lokale Polarität ignorieren |

Bei Verwendung dieser Polaritätsmetrik wird das Modell auch dann gefunden, wenn sich der Kontrast lokal ändert. Dies ist nützlich, wenn das Objekt aus einem Teil mit einem mittleren Grauwert besteht, in dem sich dunklere oder hellere Teilobjekte befinden. Die Laufzeit im Verarbeitungsmodus kann bei dieser Polaritätsmetrik jedoch erheblich größer werden. Diese Metrik kann nur auf einkanalige Bilder angewendet werden. Wird ein mehrkanaliges Bild als Trainingsbild oder Verarbeitungsbild verwendet, wird nur der erste Kanal verwendet. |

Dieser Parameter definiert die Anzahl der Pyramidenstufen, die bei der Suche verwendet werden. Der Parameter ist standardmäßig auf „auto“ festgelegt. Die „Höchste Pyramidenstufe“ wird automatisch durch easyTouch bestimmt, wenn eine Modell-ROI im Trainingsbild ausgewählt wurde. Sie können den Wert auch manuell über die zugehörige Verbindungsstelle ändern und eine Stufe zwischen 2 und 8 festlegen. Der Wert sollte so groß wie möglich gewählt werden, um die Zeit für das Finden des Objekts möglichst kurz zu halten. Wird er jedoch zu groß gewählt, wird das Modell möglicherweise nicht mehr erkannt. Daher muss er klein genug gewählt werden, damit das Modell noch erkannt wird.

Die Auswahl der geeigneten Pyramidenstufe, d. h. die höchste Pyramidenstufe, auf der mindestens eine Instanz des Formmodells gefunden werden kann, hängt von dem Modell und dem Eingabebild ab. Die geeignete „Höchste Pyramidenstufe“ kann von Bild zu Bild variieren. Bei Eingabebildern schlechter Qualität, d. h. bei defokussierten, deformierten oder verrauschten Bildern, wird unter Umständen mit den Standardeinstellungen keine Instanz des Modells gefunden, da möglicherweise Kanten fehlen oder deformiert sind. Legen Sie in diesem Fall einen niedrigeren Wert für „Höchste Pyramidenstufe“ fest.

Wird der Parameter „Höchste Pyramidenstufe“ zu klein festgelegt, dauert es länger, bis das Modell gefunden wird, und MERLIC wird verlangsamt. Dies tritt vor allem dann auf, wenn sehr große Bilder verwendet werden. In diesem Fall empfehlen wir, den Wert für „Höchste Pyramidenstufe“ zu erhöhen.

Der Parameter bestimmt die Bedingungen, unter denen das Modell im Bild erkannt wird. Die Standardeinstellung ist „Polarität verwenden“.

|

Wert |

Beschreibung |

|---|---|

|

Polarität verwenden |

Wenn diese Polaritätsmetrik verwendet wird, müssen das Objekt im Trainingsbild und das Verarbeitungsbild den gleichen Kontrast aufweisen. Wenn das Modell beispielsweise ein helles Objekt auf einem dunklen Hintergrund ist, wird das Objekt nur gefunden, wenn es ebenfalls heller als der Hintergrund ist. Diese Metrik kann nur auf einkanalige Bilder angewendet werden. Wird ein mehrkanaliges Bild als Trainingsbild oder Verarbeitungsbild verwendet, wird nur der erste Kanal verwendet. |

|

Farbpolarität ignorieren |

Bei Verwendung dieser Polaritätsmetrik wird das Modell auch dann gefunden, wenn sich der Farbkontrast lokal ändert, z. B. bei einer Änderung der Objektfarbe von grün in rot. Dieser Modus ist nützlich, wenn Sie vorab nicht wissen, in welchen Kanälen das Objekt sichtbar ist. Die Laufzeit im Verarbeitungsmodus kann bei dieser Polaritätsmetrik jedoch erheblich größer werden. Diese Metrik kann für Bilder mit einer beliebigen Anzahl von Kanälen verwendet werden. Bei Verwendung für einkanalige Bilder ist die Auswirkung wie bei „lokale Polarität ignorieren“. Die Anzahl der Kanäle bei der Erstellung des Trainingsmodells und der Suche muss nicht übereinstimmen. Dies bietet die Möglichkeit, ein Modell aus einem synthetisch generierten, einkanaligen Bild zu erstellen. Darüber hinaus müssen die Kanäle keine spektrale Unterteilung des Lichts wie in einem RGB-Bild enthalten. Die Kanäle können auch Bilder des gleichen Objekts enthalten, die bei Beleuchtung des Objekts aus unterschiedlichen Richtungen entstanden sind. |

|

globale Polarität ignorieren |

Bei Verwendung dieser Polaritätsmetrik wird das Modell auch dann im Bild gefunden, wenn der Kontrast global umgekehrt wird. Ist das Objekt beispielsweise ein helles Objekt auf einem dunklen Hintergrund, wird das Objekt nicht nur dann gefunden, wenn es heller als der Hintergrund ist (wie bei "Polarität verwenden"), sondern auch, wenn es dunkler als der Hintergrund ist. In diesem Fall wird die Laufzeit im Verarbeitungsmodus geringfügig größer. Diese Metrik kann nur auf einkanalige Bilder angewendet werden. Wird ein mehrkanaliges Bild als Trainingsbild oder Verarbeitungsbild verwendet, wird nur der erste Kanal verwendet. |

|

lokale Polarität ignorieren |

Bei Verwendung dieser Polaritätsmetrik wird das Modell auch dann gefunden, wenn sich der Kontrast lokal ändert. Dies ist nützlich, wenn das Objekt aus einem Teil mit einem mittleren Grauwert besteht, in dem sich dunklere oder hellere Teilobjekte befinden. Die Laufzeit im Verarbeitungsmodus kann bei dieser Polaritätsmetrik jedoch erheblich größer werden. Diese Metrik kann nur auf einkanalige Bilder angewendet werden. Wird ein mehrkanaliges Bild als Trainingsbild oder Verarbeitungsbild verwendet, wird nur der erste Kanal verwendet. |

Ergebnisse

Standardergebnisse

Zentrumspunkte:

Dieses Ergebnis ist eine grafische Darstellung der lokalisierten Mittelpunkte der Objekte. Sie werden als punktförmige ROIs ausgegeben. Verwenden Sie dieses Ergebnis, wenn Sie die Punkte in Form einer ROI verarbeiten möchten.

Bewertung:

Dieses Ergebnis gibt einen numerischen Wert aus, der das Maß der Übereinstimmung des gefundenen Objekts mit dem gesuchten trainierten Modell angibt. Die Ausgabe erfolgt als reelle Zahl zwischen 0 und 1. Wenn die Bewertung den Wert 1 aufweist, stimmt das gefundene Objekt mit einer Genauigkeit von 100 % mit dem trainierten Modell überein. Wird mehr als ein Objekt gefunden, werden die zugehörigen Bewertungen als Tupel ausgegeben.

X:

Dieses Ergebnis beschreibt die X-Koordinate des lokalisierten Objektmittelpunkts. Werden mehrere helle Flecken gefunden, werden die zugehörigen X-Koordinaten als Tupel ausgegeben.

Y:

Dieses Ergebnis beschreibt die Y-Koordinate des lokalisierten Objektmittelpunkts. Werden mehrere helle Flecken gefunden, werden die zugehörigen Y-Koordinaten als Tupel ausgegeben.

Orientierung:

Dieses Ergebnis beschreibt den Orientierungswinkel der gefundenen Objekte in Bezug auf die Orientierung des Trainingsmodells.

Toolstatus:

„Toolstatus“ gibt Informationen zum Status des Tools aus und kann daher für die Fehlerbehandlung verwendet werden. Weitere Informationen zu den verschiedenen Toolstatus-Ergebnissen finden Sie unter Toolstatus-Ergebnis.

Zusätzliche Ergebnisse

Modellkanten:

Dieses Ergebnis enthält die Kontur der Kanten des Trainingsmodells.

Orientierungspfeil:

Dieses Ergebnis stellt den „Orientierungspfeil“ der ROI dar, die für das Training verwendet wurde. Es wird als Kontur ausgegeben.

Verarbeitungszeit:

Dieses Ergebnis gibt die Dauer der letzten Ausführung des Tools in Millisekunden aus. Das Ergebnis wird als zusätzliches Ergebnis bereitgestellt. Es ist daher standardmäßig ausgeblendet, kann aber über die Schaltfläche neben den Toolergebnissen angezeigt werden. Weitere Informationen finden Sie im Abschnitt Verarbeitungszeit in der Tool-Referenz-Übersicht.

Anwendungsbeispiele

Dieses Tool wird in den folgenden MERLIC-Vision-App-Beispielen verwendet:

- measure_distance_to_center_led.mvapp